विचार / लेख

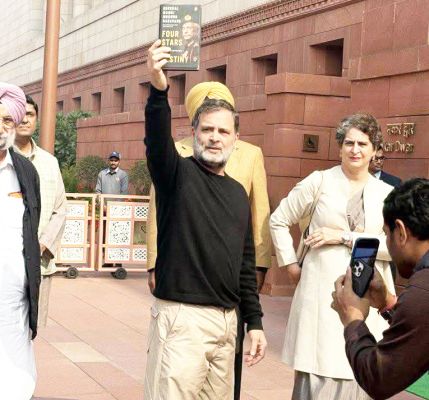

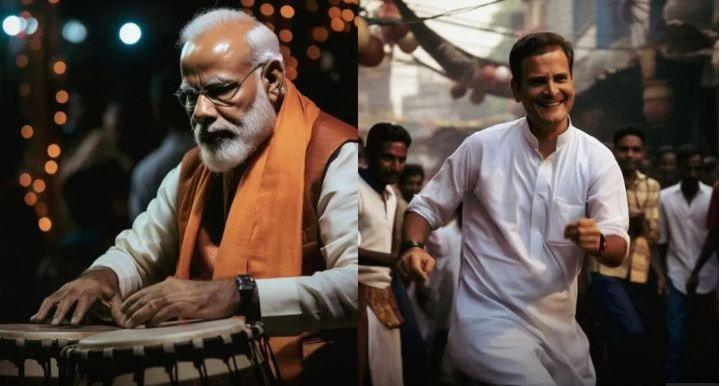

कंटेंट क्रिएटर शाहिद के इंस्टाग्राम पेज पर राहुल गांधी और नरेंद्र मोदी की एआई तस्वीरें

मेरिल सेबेस्टियन

पिछले साल नवंबर में मुरलीकृष्णन चिन्नादुरै ब्रिटेन में तमिल भाषा के एक कार्यक्रम का यू-ट्यूब पर लाइव प्रसारण देख रहे थे। मुरलीकृष्णन को लग रहा था कि इस लाइवस्ट्रीम में कुछ तो गड़बड़ी है।

उस कार्यक्रम में दुवारका नाम की एक महिला भाषण दे रही थी, जिसे तमिल उग्रवादी संगठन लिट्टे के प्रमुख वेलुपिल्लै प्रभाकरण की बेटी बताया गया था।

दिक्कत ये थी कि दुवारका की मौत एक दशक पहले ही हो चुकी थी। 2009 में श्रीलंका में चल रहे गृह युद्ध के दौरान दुवारका एक हवाई हमले में मारी गई थी।

हालांकि, उसके बाद से 23 बरस की दुवारका का शव कभी बरामद नहीं हुआ। और अब, यहां ब्रिटेन में वो मध्यम उम्र की एक महिला के तौर पर पूरी दुनिया के तमिलों से अपील कर रही थी कि वो अपनी सियासी लड़ाई को आगे बढ़ाएं।

मुरलीकृष्णन चिन्नादुरै, दक्षिण भारत के तमिलनाडु राज्य में रहने वाले एक फैक्ट चेकर हैं। उन्होंने वो वीडियो बड़ी बारीकी से देखा। उस वीडियो के अटक अटककर चलने से उन्होंने तुरंत भांप लिया कि दुवारका की जिस तस्वीर को असली बताया जा रहा था, वो असल में आर्टिफि़शियल इंटेलिजेंस (एआई) की मदद से तैयार की गई है।

इस वीडियो के जरिए जो गड़बड़ी पैदा करने की कोशिश की जा रही थी, वो मुरलीकृष्णन को तुरंत समझ में आ गई हैं। उन्होंने बताया कि, ‘तमिलनाडु के लोग इस मसले को लेकर बेहद जज़्बाती हैं। और, चुनावों के बीच ये गलत जानकारी बड़ी तेजी से फैल सकती है।’

आज जब भारत में चुनाव हो रहे हैं, तो आर्टिफिशियल इंटेलिजेंस की मदद से तैयार कंटेंट की भरमार की अनदेखी नहीं की जा सकती है। प्रचार के वीडियो, तमाम भारतीय भाषाओं में लोगों के लिए निजी ऑडियो संदेश और यहां तक कि उम्मीदवार की आवाज में मतदाताओं को की जाने वाली स्वचालित फोन काल तक इसमें शामिल हैं।

शाहिद शेख़ जैसे कंटेंट तैयार करने वालों के लिए एआई की मदद से ऐसी सामग्री तैयार करना मज़ेदार रहा, जिसमें वो राजनेताओं को ऐसे अवतार में दिखा रहे थे, जो इससे पहले कभी नहीं देखे गए। मसलन वजिऱ्श के कपड़े पहने हुए, संगीत सुनते हुए और नाचते गाते हुए।

लेकिन, जैसे जैसे आर्टिफिशियल इंटेलिजेंस के टूल और उन्नत होते जा रहे हैं, वैसे वैसे इन्हें लेकर जानकारों की चिंता बढ़ती जा रही है। खासतौर से फेक न्यूज को असली बताकर पेश करने के मामले में।

भारत के पूर्व मुख्य चुनाव आयुक्त, एस वाई क़ुरैशी कहते हैं कि, ‘अफवाहें तो हमेशा से चुनावी प्रक्रिया का हिस्सा रही हैं। लेकिन, सोशल मीडिया के इस दौर में अफवाहें जंगल की आग की तरह फैल सकती हैं।’

वो कहते हैं कि, ‘सच तो ये है कि इनसे पूरे देश में आग भडक़ उठने का डर है।’

तकनीक से शब्दों और संदेशों की हेरा-फेरी

हाल में हुई तकनीकी तरक्की का फायदा उठाने के मामले में भारत के सियासी दल कोई पहले नहीं हैं। सीमा के उस पार पाकिस्तान में इसी तकनीक ने जेल में बंद इमरान खान को एक रैली संबोधित करने का मौका दिया था।

और खुद भारत में भी प्रधानमंत्री नरेंद्र मोदी, उभरती हुई तकनीकों का इस्तेमाल असरदार चुनाव अभियान चलाने के लिए पहले से करते आए हैं। वो लोगों को हिंदी मे संबोधित करते हैं, और इसके साथ साथ उनके भाषण को सरकार द्वारा निर्मित एआई के टूल भाषिणी की मदद से तमिल भाषा में अनुवाद करके सुनाया जा रहा होता है।

लेकिन, इन तकनीकों का इस्तेमाल शब्दों और संदेशों की हेरा-फेरी के लिए भी किया जा सकता है।

अभी पिछले महीने वायरल हुए दो वीडियो में बॉलीवुड के सितारों रणवीर सिंह और आमिर खान को विपक्षी दल कांग्रेस का प्रचार करते हुए दिखाया गया था।

दोनों ही अभिनेताओं ने इन वीडियो को डीपफेक बताते हुए पुलिस में शिकायत दर्ज कराई कि इन्हें उनकी इजाजत के बगैर बनाया गया है।

इसके बाद 29 अप्रैल को खुद प्रधानमंत्री मोदी ने एआई की मदद से उनके अपने और बीजेपी के दूसरे नेताओं के भाषणों को तोड़-मरोडक़र पेश करने को लेकर चिंता जताई थी।

अगले ही दिन पुलिस ने दो लोगों को गिरफ्तार किया था।

इनमें से एक कांग्रेस पार्टी का तो दूसरा आम आदमी पार्टी का कार्यकर्ता था। इन दोनों को गृह मंत्री अमित शाह के वीडियो को काट-छांटकर पेश करने के आरोप में गिरफ्तार किया गया था।

विपक्षी दल, नरेंद्र मोदी की भारतीय जनता पार्टी पर भी इसी तरह के इल्जाम लगाते आए हैं।

सियासत में प्रतिस्पर्धा

जानकारों के मुताबिक, समस्या ये है कि इन गिरफ्तारियों के बावजूद, इन नक़ली और तोड़-मरोडक़र तैयार किए जा रहे कंटेंट से निपटने की कोई व्यापक कानूनी व्यवस्था नहीं है।

डेटा और सुरक्षा के रिसर्चर श्रीनिवास कोडाली कहते हैं, ‘इसका मतलब ये है कि अगर आप कुछ ग़लत करते हुए पकड़े जाते हैं तो आपको बस हल्की फुल्की सज़ा देकर छोड़ दिया जाएगा।’

बीबीसी को पता चला है कि राजनेताओं ने ऐसे कंटेंट तैयार करने वालों से अपने विरोधियों की पोर्नोग्राफिक तस्वीरें और मॉर्फ किए गए वीडियो तैयार करने के लिए भी कहा, ताकि उनकी छवि को नुकसान पहुंचाया जा सके।

दिव्येंद्र सिंह जादौन ने बताया कि, ‘एक बार मुझसे कहा गया था कि एक असली वीडियो का डीपफेक वीडियो तैयार करूं, क्योंकि असली वीडियो जो बड़े पैमाने पर शेयर किया जा रहा था, उससे उसमें दिख रहे राजनेता की खऱाब छवि बन रही थी।’

दिव्येंद्र बताते हैं कि, ‘इसीलिए उस नेता की टीम चाहती थी कि मैं उसका डीपफेक वीडियो तैयार करूं, जिसे वो असली बताकर प्रचारित कर सकें।’

दिव्येंद्र सिंह जादौन दि इंडियन डीपफेकर (टीआईडी) के संस्थापक हैं, जो आर्टिफिशियल इंटेलिजेंस के मुफ़्त में उपलब्ध सॉफ्टवेयर का इस्तेमाल करके लोगों को राजनेताओं की प्रचार सामग्री तैयार करने में मदद करती है।

वो कहते हैं कि उनकी कंपनी अपने हर कंटेंट में डिसक्लेमर लगाने पर ज़ोर देती है, ताकि ये स्पष्ट रहे कि ये असली वीडियो नहीं है। लेकिन, इस पर काबू पाना फिर भी दुश्वार है।

तेजी से फैलती गलत सूचना

शाहिद शेख, पश्चिम बंगाल की एक मार्केटिंग एजेंसी के लिए काम करते हैं। उन्होंने देखा है कि उनके बनाए कंटेंट को बिना उनको क्रेडिट दिए ही राजनेता या फिर राजनीतिक दलों के सोशल मीडिया पेज पर शेयर किया जाता है।

शाहिद शेख कहते हैं कि, ‘एक राजनेता ने मेरी बनाई हुई नरेंद्र मोदी की तस्वीर को बिना किसी संदर्भ के इस्तेमाल किया और ये भी नहीं बताया कि ये तस्वीर आर्टिफिशियल इंटेलिजेंस की मदद से तैयार की गई है।’

और, अब तो डीपफेक बनाना इतना आसान हो गया है कि इसे कोई भी तैयार कर सकता है।

दिव्येंद्र जादौन बताते हैं कि, ‘पहले जो काम करने में सात से आठ दिन लग जाते थे, अब वो कंटेंट तीन मिनट में तैयार हो जाता है। आपके पास बस एक कंप्यूटर होना चाहिए।’

बीबीसी की टीम ने अपनी आंखों से देखा कि दो लोगों के बीच एक फर्जी फोन कॉल कराना कितना आसान है। ये फोन कॉल मेरे और पूर्व अमरीकी राष्ट्रपति के बीच थी।

इन जोखिमों के बावजूद, भारत ने शुरुआत में कहा था कि वो आर्टिफिशियल इंटेलिजेंस के लिए कोई कानून बनाने पर विचार नहीं कर रहा है। हालांकि, इस साल मार्च महीने में सरकार उस वक़्त अचानक हरकत में आ गई, जब ‘क्या मोदी फासीवादी हैं?’ सवाल पर गूगल के जेमिनी चैटबॉट के जवाब को लेकर विवाद खड़ा हुआ था।

भारत के सूचना और प्रौद्यौगिकी राज्यमंत्री राजीव चंद्रशेखर ने कहा कि इससे भारत के आईटी कानूनों का उल्लंघन हुआ है।

उसके बाद से भारत सरकार ने तकनीकी कंपनियों से कहा है कि वो जेनरेटिव एआई के ‘कम परीक्षण किए गए’ और ‘भरोसा न करने लायक’ मॉडल या टूल जारी करने से पहले सरकार से इजाज़त लें।

सरकार ने इन कंपनियों को ऐसे टूल्स के उन जवाबों को लेकर भी चेतावनी जारी की ‘जो चुनावी प्रक्रिया की अक्षुण्णता के लिए खतरा पैदा करते हों।’

लेकिन, इतने भर से काम नहीं चलने वाला- फैक्ट चेक करने वाले कहते हैं कि ऐसे कंटेंट का लगातार पर्दाफाश करना बहुत बड़ी चुनौती है, खास तौर से चुनाव के दौरान जब ग़लत सूचनाओं की बाढ़ आ जाती है।

तमिलनाडु में मीडिया की निगरानी करने वाला संगठन चलाने वाले मुरलीकृष्णन अन्नादुरै कहते हैं कि, ‘सूचना 100 किलोमीटर प्रति घंटे की रफ़्तार से चलती है। लेकिन, हम जिस बात को ग़लत ठहराते हैं, वो 20 किलोमीटर प्रति घंटे की धीमी गति से फैलती है।’

श्रीनिवास कोडाली कहते हैं कि ये नकली कंटेंट तो मुख्यधारा के मीडिया तक में फैल रहे हैं। इसके बावजूद, ‘चुनाव आयोग आर्टिफिशियल इंटेलिजेंस को लेकर सार्वजनिक रूप से खामोशी बनाए हुए है।’

श्रीनिवास कहते हैं कि, ‘इनके लिए कोई नियम नहीं है। कोई वास्तविक नियम क़ायदे बनाने के बजाय उन्होंने ये काम तकनीकी उद्योग के भरोसे छोड़ दिया है।’

जानकार कहते हैं कि इसका कोई ठोस समाधान नहीं है। एस वाई क़ुरैशी कहते हैं कि, ‘लेकिन, अभी अगर फेक वीडियो फॉरवर्ड करने वालों के ऊपर कार्रवाई होती है, तो शायद दूसरों को अपुष्ट जानकारी साझा करने से डर लगेगा।’ (bbc.com/hindi)